Na czym najwięcej zarabia OpenAI? To nie ChatGPT

Sam Altman – szef OpenAI mówi, że to API a nie subskrypcje ciągną firmę. Koncern rozwija model licencyjny i testuje reklamy, aby pokryć rosnące koszty infrastruktury.

Ponad miliard dolarów rocznie dla OpenAI

Spółka OpenAI osiągnęła w ostatnim miesiącu ponad 1 miliard dolarów nowych rocznych przychodów, które nie pochodzą z subskrypcji ChatGPT. Informację przekazał Sam Altman na X. Jak napisał, wzrost ten pochodził wyłącznie z działalności API OpenAI:

„Ludzie myślą o nas głównie przez pryzmat ChatGPT, ale zespół API wykonuje niesamowitą pracę.”

Ten miliard dolarów dotyczy stałych dochodów rocznych (annual recurring revenue) generowanych wyłącznie przez API. Są to pieniądze pochodzące ze stałego korzystania z technologii przez firmy, które integrują modele OpenAI ze swoimi usługami i systemami. Nie obejmuje to przychodów z ChatGPT ani innych produktów konsumenckich.

Gdy sztuczna inteligencja przeklina własną firmę. Jak DPD musiało wyłączyć swojego chatbota po skandalu z klientem

Czym jest API OpenAI i co dokładnie sprzedaje firma

Firma nie sprzedaje firmom znanego nam wszystkim ChatGPT. Zamiast tego sprzedaje dostęp do technologii stojącej za tym czatem. Ten dostęp dostarczany jest przez tzw. API.

API pozwala podłączyć modele OpenAI do własnych systemów i aplikacji. Przedsiębiorstwo może stworzyć własną usługę opartą na sztucznej inteligencji, bez konieczności budowania i trenowania własnego modelu językowego.

Przedsiębiorstwo może mieć pomysł na automatyzację fakturowania, obsługę klientów, analizę dokumentów, wyszukiwanie informacji lub zarządzanie magazynem. Zamiast inwestować ogromne środki w rozwój własnej AI, korzysta z modeli OpenAI jak z wynajętej technologii. ChatGPT nie musi być w ogóle widoczny dla użytkownika końcowego. Technologia działa w tle.

Jak wygląda rozliczenie w modelu API

Klienci korzystający z API OpenAI nie płacą stałego abonamentu ani ryczałtu „za dostęp”. Rozliczenie odbywa się wyłącznie za faktyczne użycie technologii, czyli za to, ile razy i jak intensywnie modele są wykorzystywane w danej aplikacji lub systemie.

AI już zmienia rynek pracy. Liczba ofert w Polsce spadła do poziomu z pandemii

Podstawową jednostką rozliczeń są tokeny. Token to fragment tekstu, zwykle kilka znaków lub część słowa. Każde zapytanie wysłane do modelu oraz każda wygenerowana odpowiedź składają się z określonej liczby tokenów. Im dłuższe pytanie, im więcej danych do analizy i im obszerniejsza odpowiedź, tym więcej tokenów jest przetwarzanych, a więc tym wyższy koszt pojedynczego użycia modelu.

W codziennym użyciu oznacza to, że koszty są ściśle powiązane ze skalą działania produktu. Jeśli firma ma niewielką aplikację, kilku klientów i sporadyczne zapytania do modelu, rachunki za API są relatywnie niskie. Jeśli jednak produkt szybko się rozwija, obsługuje setki tysięcy użytkowników albo tysiące zapytań dziennie, zużycie tokenów rośnie lawinowo, a wraz z nim rośnie koszt korzystania z API.

Z perspektywy OpenAI model polega na tym, że firma zarabia wtedy, gdy jej modele są intensywnie wykorzystywane, niezależnie od tego, czy klient na tym zarabia, czy jeszcze dokłada do biznesu. Wynik finansowy aplikacji końcowej nie ma znaczenia. Liczy się wyłącznie wolumen użycia technologii, czyli liczba zapytań, przetwarzanych danych i generowanych odpowiedzi.

To właśnie dlatego przychody z API mogą rosnąć bardzo szybko. Gdy rośnie popularność aplikacji klienta, automatycznie rośnie zużycie modeli OpenAI, a wraz z nim stałe dochody roczne generowane przez API.

Kto korzysta z API OpenAI

Z API OpenAI korzysta wiele znanych startupów technologicznych, ponieważ jest to dla nich najszybszy sposób na wdrożenie generatywnej sztucznej inteligencji do własnych produktów. Firma z pomysłem nie musi budować własnego modelu językowego, nie musi go trenować ani utrzymywać kosztownej infrastruktury. Zamiast tego podłącza się do modeli OpenAI przez API i używa ich jako gotowej warstwy inteligencji w swoim systemie.

Dobrym przykładem jest Perplexity. To wyszukiwarka oparta na sztucznej inteligencji, w której użytkownik wpisuje pytanie, a system nie tylko zwraca linki, ale generuje odpowiedź tekstową. W tym procesie modele OpenAI odpowiadają za analizę pytania użytkownika, dobór i porządkowanie informacji oraz tworzenie spójnej odpowiedzi. Perplexity nie buduje własnego modelu językowego. Zamiast tego wykorzystuje technologię OpenAI, którą integruje ze swoją usługą.

AI wkracza do administracji: Częstochowa jako pierwszy polski samorząd testuje PLLuM

Podobnie działa Harvey, jeden z najszybciej rozwijających się startupów prawniczych. Jego narzędzia wspierają prawników w pracy z dokumentami prawnymi, umowami, aktami spraw i orzeczeniami. Modele OpenAI pomagają m.in. streszczać dokumenty, wyciągać kluczowe informacje, porównywać zapisy, porządkować argumenty oraz tworzyć robocze wersje tekstów. Harvey rozwija własny produkt i interfejs, natomiast OpenAI dostarcza model przetwarzający język.

W obu przypadkach firmy rozliczają się z OpenAI przez API, a nie poprzez jednorazową licencję. Oznacza to płatność za faktyczne użycie technologii. Im więcej zapytań do modelu, im więcej przetworzonego tekstu i wygenerowanych odpowiedzi, tym wyższe koszty po stronie klienta. Właśnie dlatego przychody z API mogą rosnąć bardzo szybko, gdy rośnie liczba użytkowników końcowych takich usług.

OpenAI ma spore rachunki za prąd

Rozwój sztucznej inteligencji bezpośrednio zwiększa zapotrzebowanie na energię elektryczną. Duże modele językowe działają w centrach danych, które pracują nieprzerwanie, 24 godziny na dobę. W przeciwieństwie do klasycznych serwerów, obliczenia związane z AI generują stałe i wysokie obciążenie sieci.

Z danych International Energy Agency (IEA) wynika, że globalne zużycie energii przez centra danych wzrośnie z około 460 TWh w 2024 roku do blisko 1 000 TWh w 2030 roku. Oznacza to ponad dwukrotny wzrost w sześć lat. IEA wskazuje jednocześnie, że głównym źródłem tego wzrostu są obliczenia związane z AI, a nie tradycyjne usługi cyfrowe.

Równocześnie rośnie obciążenie sieci energetycznych. W Stanach Zjednoczonych centra danych odpowiadają już dziś za ponad 4 proc. całkowitego zużycia energii elektrycznej. Prognozy pokazują, że do końca dekady ten udział wzrośnie dalej, szczególnie w regionach, gdzie powstają duże klastry obliczeniowe dla AI.

Dla firm takich jak OpenAI problemem staje się nie tylko cena energii, lecz przede wszystkim dostęp do mocy. Nowe centra danych wymagają przyłączy liczonych w setkach megawatów, a w skrajnych przypadkach w gigawatach. W wielu lokalizacjach infrastruktura przesyłowa nie nadąża za tym popytem. Firmy muszą więc finansować rozbudowę sieci, budowę nowych stacji transformatorowych i modernizację linii przesyłowych.

AI wie już, na co zachorujesz – i to jest dobra informacja. Delphi-2M przewiduje choroby nawet 20 lat w przyszłość

A wydatki rosną. Sam Altman mówił o inwestycjach sięgających około 1,4 biliona dolarów w kolejnych latach. Obejmują one centra danych, sprzęt obliczeniowy, infrastrukturę energetyczną oraz przyłącza sieciowe.

Właśnie dlatego subskrypcje ChatGPT nie wystarczają, aby finansować rozwój AI na przemysłową skalę. OpenAI potrzebuje stałych, przewidywalnych dochodów, które rosną wraz z użyciem technologii. Z tego powodu firma opiera model finansowy na API jako źródle stałych dochodów rocznych, a równolegle testuje licencjonowanie technologii i inne formy monetyzacji.

Energia stała się kluczowa dla rozwoju sztucznej inteligencji, na równi z danymi i mocą obliczeniową.

Reklamy w ChatGPT?

Przez długi czas OpenAI unikało zarabiania na reklamach, mimo że to podstawowe źródło dochodów największych firm technologicznych. Dla porównania, Google wygenerował w 2025 roku około 300 mld dolarów z reklam, głównie z wyszukiwarki i YouTube. Meta zarobiła na reklamach około 180 mld dolarów, opierając na nich niemal cały biznes Facebooka i Instagrama. Skala rynku jest więc ogromna.

W maju 2024 roku Sam Altman mówił na Uniwersytecie Harvarda:

„Połączenie reklam i sztucznej inteligencji jest dla mnie wyjątkowo niepokojące. Reklamy traktuję jako ostateczność.”

Obawiał się, że reklamy mogłyby zostać odebrane jako część odpowiedzi generowanych przez model, a nawet że mogłyby wpływać na ich wartość merytoryczną. To odróżnia chatbota od wyszukiwarki czy mediów społecznościowych, gdzie reklama jest wyraźnie oddzielona od treści.

Sytuację zmieniły pieniądze i zużycie energii. Według danych International Energy Agency (IEA) centra danych zużywały w 2024 roku około 460 TWh energii elektrycznej rocznie, a sztuczna inteligencja jest głównym źródłem dalszego wzrostu. Do 2030 roku globalne zużycie energii przez centra danych może sięgnąć blisko 1 000 TWh rocznie. Modele językowe należą do najbardziej energochłonnych obciążeń obliczeniowych, ponieważ energia jest zużywana zarówno podczas trenowania, jak i przy każdym zapytaniu użytkownika.

Przy setkach milionów użytkowników, z których wielu korzysta z wersji darmowej, oznacza to stały i wysoki pobór mocy, niezależny od liczby płacących klientów. W Stanach Zjednoczonych centra danych odpowiadają już za ponad 4 proc. całkowitego zużycia energii elektrycznej, a nowe ośrodki dla AI wymagają przyłączy liczonych w setkach megawatów. W tych warunkach same subskrypcje ChatGPT i przychody z API przestały wystarczać jako jedyne źródła finansowania dalszego rozwoju OpenAI.

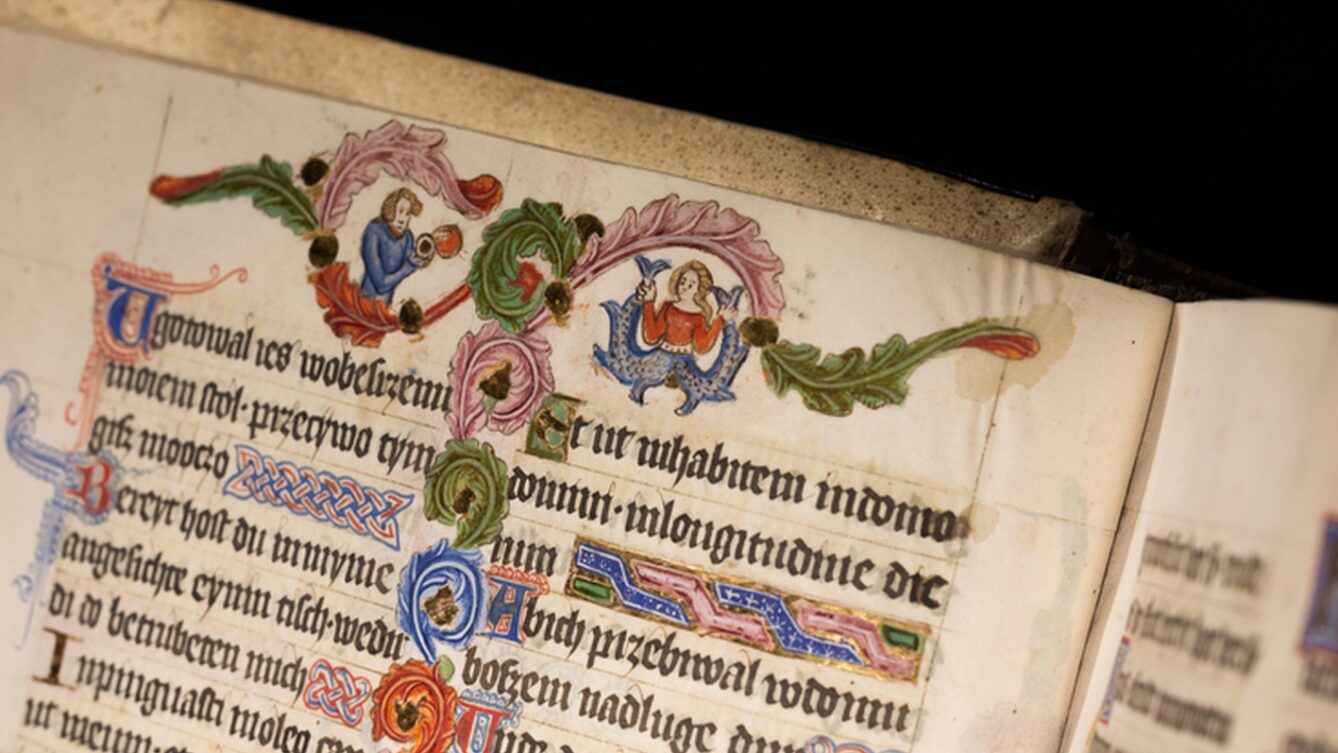

Jak wytrenować średniowiecznego bota? Biblioteka Narodowa uruchomiła infolinię po staropolsku

W czerwcu Altman przyznał w firmowym podcaście, że nie jest całkowicie przeciwny reklamom, pod warunkiem ostrożnego wdrożenia. Niedługo potem OpenAI zapowiedziało testy reklam w ChatGPT. Mają być wyraźnie oznaczone, umieszczone poza główną treścią odpowiedzi. Treść rozmów z czatem ma nie być wykorzystywana do targetowania reklam.

Kolejne źródło dochodów: licencjonowanie technologii

Firma podkreśla, że nie chce finansować rozwoju sztucznej inteligencji kosztem jakości produktu i zaufania użytkowników. Dlatego, jak może, opóźnia wprowadzanie reklam. Jednocześnie prąd i infrastruktura kosztują, a rozwój coraz kolejnych modeli generuje wydatki, których nie da się pokryć wyłącznie subskrypcjami i API. To dlatego OpenAI szuka kolejnych sposobów finansowania, które nie ingerują bezpośrednio w treść odpowiedzi.

Jednym z takich rozwiązań jest licencjonowanie technologii, czyli model, w którym OpenAI uczestniczy w przychodach końcowego produktu, zamiast rozliczać się za bieżące użycie modeli. O tym mówiła Sarah Friar, dyrektorka finansowa OpenAI, w The OpenAI Podcast:

„Załóżmy, że licencjonujemy naszą technologię do odkrywania leków. Dochodzi do przełomu, lek trafia na rynek i wtedy otrzymujemy licencyjną część całej sprzedaży.”

W tym przypadku OpenAI wnosi swój wkład technologiczny w prace badawcze i rozwojowe, na przykład w sektorze farmaceutycznym, gdzie modele mogą przyspieszać analizę danych i proces odkrywania nowych leków. Jeśli projekt się nie powiedzie, firma nie zarabia. Jeśli zakończy się sukcesem i lek trafi na rynek, OpenAI otrzymuje ustalony procent sprzedaży jako wynagrodzenie za udział technologii w odkryciu.

Sam model biznesowy wolałby opierać się na technologii, a nie na reklamach w rozmowie z użytkownikiem. I trudno się dziwić. Wystarczy spędzić kilka minut na YouTube albo Facebooku, żeby zrozumieć, że reklamy to coś, czego się nie lubi. Jeśli więc da się utrzymać rozwój AI bez nich, pozostaje tylko trzymać kciuki za finanse OpenAI.

Źródła: Business Insider, The OpenAI Podcast, International Energy Agency (IEA), Bloomberg, Reuters, Harvard University

Duńczycy omijają produkty z USA. Niemcy czują „odrazę”

Praca tymczasowa: limit 18 miesięcy u jednego pracodawcy

Czytaj więcej